Sam Altman, consejero delegado de OpenAI, concedió una extensa entrevista hace unos días en la que ha dejado bastante claras sus intenciones con respecto al futuro GPT-4, la inteligencia artificial en general, su empresa y el uso de ChatGPT.

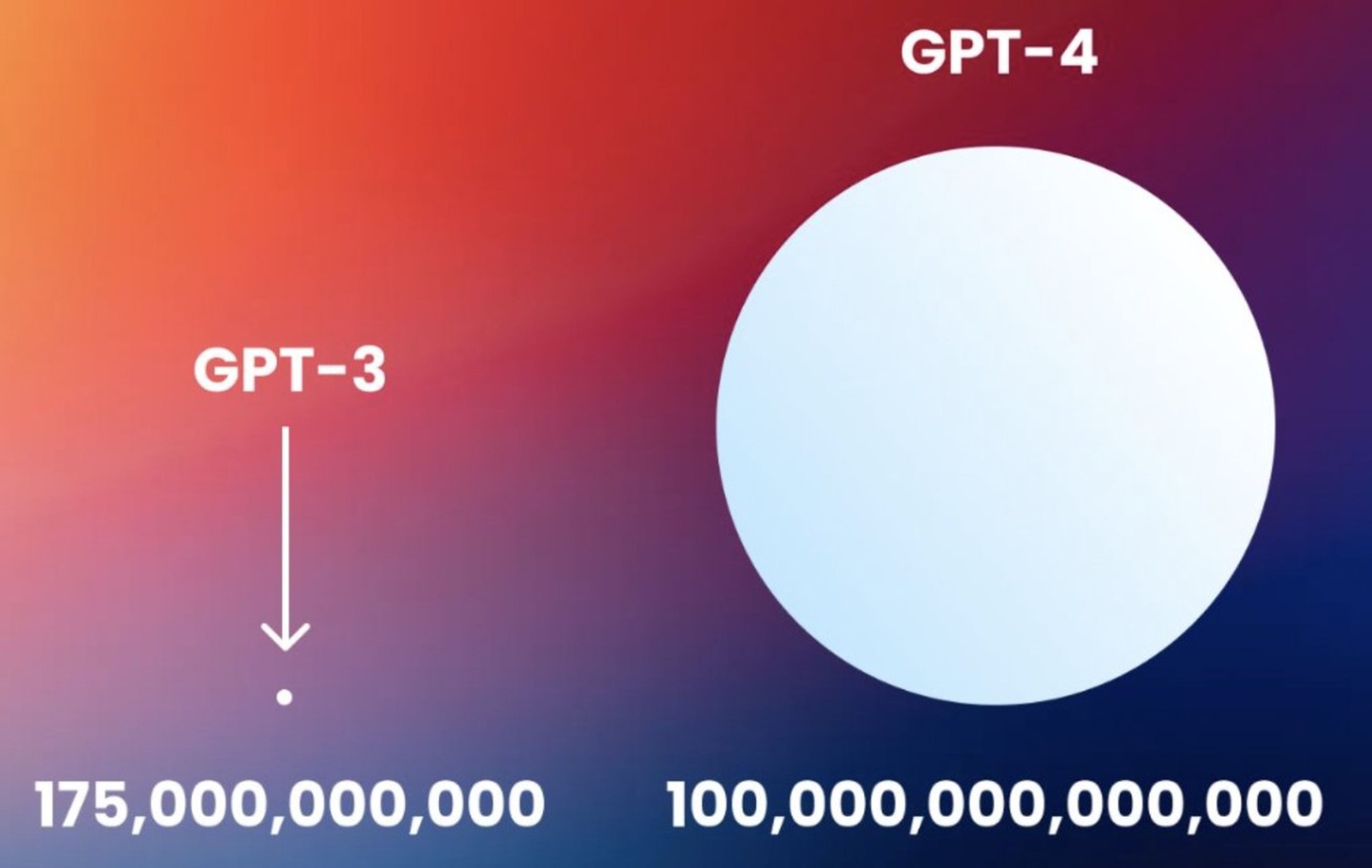

En pocas palabras y yendo directamente al grano, Altman califica de “cosa ridícula” la rumorología que rodea a GPT-4. Y es que, los rumores sobre modelos de tamaño gigantesco circulan por Twitter y similares, y este no tiene “ni idea de dónde viene todo eso”.

Igualmente, con herramientas como ChatGPT, entre otras, ya se ha demostrado que el número de parámetros no lo es todo, sino que la arquitectura, la cantidad de datos y la calidad también desempeñan un papel importante en el entrenamiento.

Destacar lo que Altman tiene que decir al respecto de esa cantidad exagerada de parámetros: “La fábrica de rumores sobre GPT-4 es algo ridículo. No sé de dónde sale todo esto. La gente está pidiendo a gritos que la decepcionen, y lo harán”.

Queremos, casi primero de todo, dejaros con este increíble vídeo de Dot CSV que tienes arriba y que resume a la perfección (para que no se haga demasiado larga), la entrevista que hicieron a Sam Altman por StriclyVC, subtitulada.

Altman ya insinuó en septiembre de 2021 que GPT-4 podría diferenciarse de GPT-3 por la eficiencia y la calidad de los datos más que por el mero número de parámetros. Modelos como Chinchilla o Sparse Luminous Base demuestran que los sistemas lingüísticos con menos parámetros pero con una arquitectura más eficiente y entrenados con más datos pueden rendir bien y ese el punto a tener en cuenta.

Cuando se le preguntó por un gráfico viral que supuestamente compara el número de parámetros de GPT-3 (175.000 millones) con GPT-4 (100 billones), Altman lo calificó de “completa gilipollez”.

“La fábrica de rumores sobre GPT-4 es algo ridículo. No sé de dónde sale todo esto”, dijo el CEO de OpenAI. “La gente está pidiendo a gritos que la decepcionen, y lo harán. El bombo es como… No tenemos una AGI real y eso es lo que se espera de nosotros” añade.

El futuro GPT-4, las AGI y una IA capaz de generar vídeo

Todos los rumores apuntan a que deberíamos estar cerca de GPT-4. A pesar de lo esperado de esta noticia sobre la inteligencia artificial, los detalles exactos sobre GPT-4 han sido bastante escasos.

OpenAI no ha revelado mucha información sobre el nuevo modelo, como sus características o sus capacidades. No obstante, los avances en el campo de la IA, pueden ofrecer algunas pistas sobre lo que podemos esperar de GPT-4.

Algo de lo que ya se está seguro es de que será capaz de generar textos más parecidos a los humanos y responder a las preguntas de los usuarios de una forma más natural que las versiones anteriores del modelo, como ya hemos visto con ChatGPT. Contará con más parámetros que GPT-3, sí, pero no tantos como se rumorea y es probable que GPT-4 dependa menos de la precisión de las instrucciones.

Por otro lado, tenemos el tema de las AGI. Para que lo comprendamos a la perfección, una AGI (Inteligencia Artificial General), se describe como la representación de capacidades cognitivas humanas generalizadas en un software de modo que, ante una tarea desconocida, el sistema puede encontrar la solución. En otras palabras, es la capacidad de la IA para aprender del mismo modo que los humanos.

También puede denominarse como IA fuerte, IA completa o acción inteligente general. Sin embargo, algunas fuentes reservan el término IA fuerte para los programas informáticos que experimentan sensibilidad o conciencia.

Pues bien, en cuanto a este tema, Altman dice lo siguiente: “Cuanto más nos acercamos, más me cuesta responder. Porque creo que va a ser mucho más borroso y una transición mucho más gradual de lo que la gente piensa”.

Este también anunció que OpenAI está trabajando en un sistema de IA generativa para vídeo. Google ya ha presentado tres sistemas de texto a vídeo con Imagen Video, Phenaki y una combinación de ambos. Meta también mostró un sistema de texto a vídeo con Make-a-Video, así que esperamos con ansias la propuesta de OpenAI.

Altman explica:“no me gustaría hacer una predicción segura sobre cuándo”. “Nosotros lo intentaremos, otros lo intentarán… Es un proyecto de investigación legítimo. Es un proyecto de investigación legítimo. Podría ser muy pronto; podría tardar un tiempo”.

¿Nos encontramos ante el fin de Google? esto es lo que opina Altman

El CEO de OpenAI no ha querido hacer demasiados comentarios sobre las declaraciones de Google en el sentido de que los chatbots aún no son lo bastante seguros como para desplegarlos de forma generalizada.

“Creo que siempre que alguien habla de que una tecnología será el fin de alguna otra empresa gigante, suele equivocarse. Creo que la gente se olvida de que aquí pueden hacer un contragolpe, y son como muy listos, muy competentes. Creo que en algún momento se producirá un cambio en las búsquedas, pero no tan drástico como la gente piensa a corto plazo”, explica.

Sin embargo, dijo que espera que los medios llamen la atención a Google sobre esta afirmación si la empresa lanza un producto de todos modos. Al parecer, la empresa de búsquedas tiene previsto lanzar chatbots centrados en la seguridad y hasta 20 productos de IA en 2023.

Lo que sí que ha querido dejar muy claro y que resulta bastante interesante, es que considera que el sistema educativo no debería depender de detectores de texto de IA. Y es que, los modelos lingüísticos como ChatGPT o GPT-3 proporcionan a los estudiantes una automatización de tareas y redacciones fácil de usar.

“Entiendo por qué los educadores se sienten así. […] Vamos a intentar hacer algunas cosas a corto plazo y puede que haya formas de ayudar a los profesores o a cualquiera a ser un poco más propensos a detectar la salida de un sistema similar al GPT”, afirma Altman. Ciertamente esto es algo que poco a poco ya estamos viendo cómo salen a la luz.

Sin embargo, añade Altman, la sociedad no debería confiar en estas soluciones a largo plazo, ya que casi cualquiera puede encontrar la forma de burlar estos detectores. Según este, son importantes para una fase inicial, pero es imposible desarrollar detectores perfectos.

“Vivimos en un mundo nuevo en el que tenemos que adaptarnos al texto generado. Eso está bien”, dice, haciendo una comparación con la aparición de las calculadoras. Los modelos lingüísticos son “más extremos”, dice, pero también ofrecen “ventajas extremas”.

Por último, un apunte final que nos pareció muy curioso. Según explica Altman en relación a esa locura incipiente por el futuro laboral de muchos puestos de trabajo, este lo tiene claro: los puestos de trabajo basados exclusivamente en el uso de datos y ordenadores se verán afectados.

Sin embargo, aquellos trabajos manuales, que lógicamente la inteligencia artificial no puede llevar aún a cabo con soltura, serán mejor valorados y eso se reflejará en los salarios.